本文从视觉、追踪和导航三个方面入手,以近年来的新应用为例,带领读者一窥机器人与昆虫之间奇妙的化学反应。

很多工程师的梦想都是创造出能够在复杂的环境下稳定胜任一系列任务——比如行走和导航——的机器人。为了实现这一目标,早期的研究者们试图将机器人身处的环境抽象化,然后根据其所可能应对的情况和任务制定一系列规则,并赋予机器人一定的推理能力。在这段期间, 全世界范围内也许最成功的机器人是名叫赫伯特的机器人。

赫伯特的前身是由西屋电气工程师 Roy J. Wensley 开发用来远程调用变电系统的机器人 Televox,仅由一组控制单元组成。Televox 本质上是一个声控系统,为了实现远程遥控的目的,该控制单元的一部分放在变电站另一部分则放置于调度员处。调度员可以利用 Televox 将指令转为不同的声音频率发送到另一端,经过解码后再执行相应操作。这一发明成功后,Wensley 进一步开发,并将 Televox 包装为了一个有“脸”、身体和身体的机器人,也就是赫伯特机器人。

图:世界上最早的机器人之一:Herbert Televox 和其开发者 Roy J. Wensley

source: https://medium.com/robotics-today/first-humanoid-robot-ever-87df3ee079b0

用今天的眼光来看,赫伯特也许完全算不上智能,因为它主要是靠规则驱动的,它的行为与人也并不相似。以当时最为人津津乐道的赫伯特作为家庭助手为例,操作人必须按照相对固定的脚本缓慢的向赫伯特传达命令,有时还必须按下特定的按钮来进行选择或确认。因为赫伯特并不能真正理解操作人的语音,它只能识别一系列已经写入系统的指令——还是在固定的音节上。可以说,赫伯特只能在其系统内规定的规则范围内工作,这与今天大行其道的联结主义 (connectionism) 是不同的。

联结主义, 又称仿生主义,认为心理现象可以用简单并一致的网络——如神经网络——来描述,不同的行为可以通过这些基础结构之间复杂的互动实现,这与人脑工作的方式相似。因此,联结主义追求用简洁的方式构建有通用性的解法,而规则驱动的算法则是 case by case,有很大的可能会随着环境的复杂度增加而变得过于庞大。

显然,随着拟人机器人的发展,不少学者也转向了其他方向来试图开发更类人、具有更高智能的机器人。一些研究者将目光投向自然界,试图从动物——比如昆虫等结构比较简单的动物——身上利用联接主义进行研究、学习和模仿。这不难理解,从昆虫的神经科学研究上看,昆虫的神经系统比大部分动物都简单很多,使对昆虫的大脑建模相对来说简单。但另一方面,许多昆虫的大脑在大小、重量上都不值一提,有些甚至还“视力其差”,但这并不影响昆虫高效、稳定的完成觅食和协作等复杂的行为。此外,尽管昆虫的身体类型、行为、栖息地和生活方式种类繁多,但各个物种的大脑组织之间仍存在许多令人惊讶的一致性,这表明它们可能是有效,高效和通用的解决方案。[3]

本文从视觉、追踪和导航三个方面入手,以近年来的新应用为例,带领读者一窥机器人与昆虫之间奇妙的化学反应。

一、视觉场景识别 - A Hybrid Compact Neural Architecture for Visual Place Recognition

在视觉场景识别领域,流行的算法大致可以分为两类:以深度学习为代表的更多依赖于计算机科学的模型,和利用大脑的特性建模的更多依赖于神经科学的模型。本文作者则旨在结合两类研究的优点,实现新的紧凑而高性能的模型。

视觉位置识别(VPR)是指仅基于图像所提供的视觉线索,而不使用任何其他信息,来识别图像中描绘的位置的任务[6]。对于在现实环境中长时间运行的任何机器人系统或自动驾驶车辆而言,可靠地执行视觉位置识别(VPR)都是一项挑战。因为同一个地方因为时间,如白天 / 夜晚或天气 / 季节周期,的变化可能看起来完全不相似,而多个地方在某些特定的情况下反而可能看起来十分相似。另外一个问题是目前流行的预训练模型大多是在单个图像上训练的,虽然这些模型也取得了很好的成绩,但是期通常会忽略连续图像内所蕴含的时间信息。

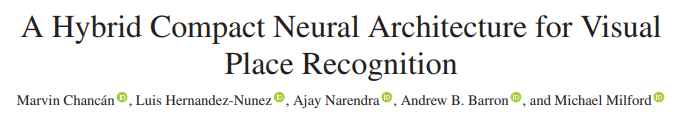

而昆虫等生物却能够非常有效地从低分辨率数据中提取有关其环境的信息,它们能够在各种环境条件下(不同光照、对比度等)强大地执行视觉处理任务。一般认为,昆虫对位置的识别主要是通过蕈形体(mushroom bodies)实现的。蕈形体是昆虫或其他节肢动物和一些环节动物如沙蚕脑中的一对结构[7],其名字来自于其大致半球形的花萼,这个花突通过中枢神经束或花序梗与大脑的其余部分相连。下图标亮了果蝇大脑中的蕈形体。蕈形体的结构可以简化为多层感知器(MLP),它涉及蜜蜂和蚂蚁的嗅觉和视觉信息的分类、学习和识别。这些昆虫的感官接受到经过密集编码和高度处理的输入,并传递给蕈形体,后者则将该信息稀疏地连接到蕈形体内的大量内在神经元。

图:果蝇大脑中的蕈形体

图源:维基百科 https://en.wikipedia.org/wiki/Mushroom_bodies

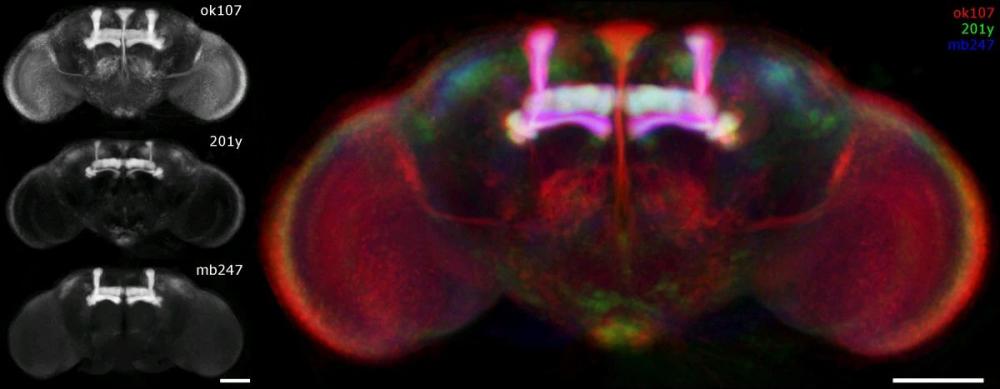

根据果蝇嗅觉神经回路的工作机制,作者提出了仅包含两层全连接层的 FlyNet 算法(FLA)。图像在预处理后将以 10% 的采样率被输入到第一层网络当中。当第二层全连接层的输出其编码的表示后,仅有 50% 的输出值将被设置被 1,其他则被设置为 0,以获得一个简洁的二进制特征表示。该网络的具体结构如下图所示:

图:FNA 算法图示

图源:Chancan, M., Hernandez-Nunez, L., Narendra, A., Barron, A. B., & Milford, M. (2020). A hybrid compact neural architecture for visual place recognition. IEEE Robotics and Automation Letters, 5(2), 993-1000. https://doi.org/10.1109/LRA.2020.2967324

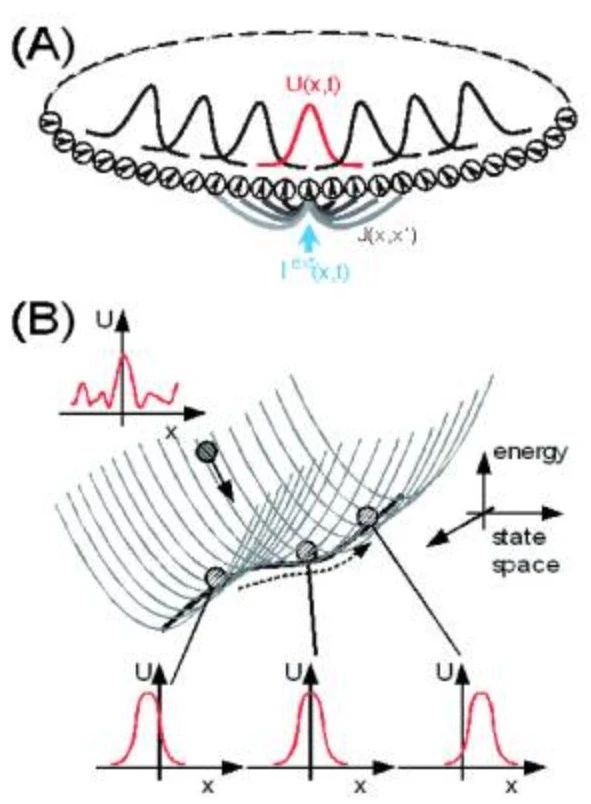

为了处理图像序列中的时间维度,作者在 FlyNet 上叠加了一个一维连续吸引子神经网络(continuous attractor neural network, CANN)。CANN 也是一个典型的仿生智能例子——一般认为大脑在执行一些计算任务时会采用特定结构的神经网络,CANN 就是基于此而开发的。CANN 由吸引子组成,它们之间有局部连接。此外,网络内有兴奋性与抑制性的两种活动,从而保证网络即能够形成有意义的空间活动,又不会在正反馈的叠加下爆炸。因此一个吸引子可以使用兴奋性和抑制性连接来激发或抑制自身以及附近的吸引子。CANN 在数学表示和结构上具有良好的特性,如空间平移不变性 [8]。

图:(A)朝向编码的一维 CANN 的图示(B)一维 CANN 的稳定状态,每个吸引子对应一个高斯波包活动状态。

图源:Wu, S., Wong, K. Y., Fung, C. C., Mi, Y., & Zhang, W. (2016). Continuous Attractor Neural Networks: Candidate of a Canonical Model for Neural Information Representation. F1000Research, 5, F1000 Faculty Rev-156. https://doi.org/10.12688/f1000research.7387.1

在本文中,由 FlyNet 输出的二进制图像特征将被输入到 CANN 中,如下图所示,以达到对 FlyNet 的输出进行时间滤波的目的。

图:FlyNet+CANN 混合神经网络架构

图源:Chancan, M., Hernandez-Nunez, L., Narendra, A., Barron, A. B., & Milford, M. (2020). A hybrid compact neural architecture for visual place recognition. IEEE Robotics and Automation Letters, 5(2), 993-1000. https://doi.org/10.1109/LRA.2020.2967324

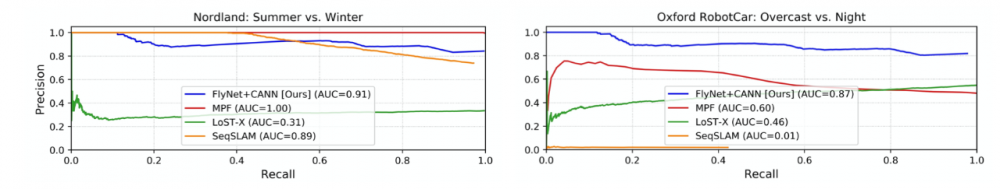

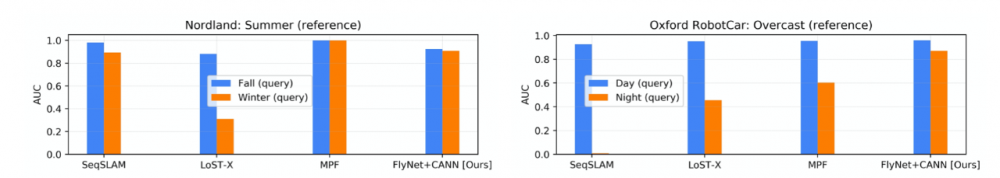

作者在 Nordland 和 Oxford RobotCar 数据集上 FlyNet + CANN 以及目前的 SOTA 算法进行了对比,指标为 AUC (area under curve)。该数据集内的图像大多为 1000*1000 以上的较高分辨率图像,但在测试 FlyNet + CANN 时作者将其一概下采样为 32*64 的灰度图像。考虑到分辨率的大幅下降,这个信息损失还是很惊人的。个别 SOTA 算法使用了 VGG16 等对图像分别率有要求的结构,因而作者没有将图像也图样下采样到 32*64, 但有将最终输出的特征进行下采样到 FlyNet 输出特征一样的维度。

下图显示了 FlyNet + CANN 和 SOTA 算法的对比结构。在 Nordland 数据集上,MPF 表现更好,AUC 达到了惊人的 100%,能够同时在秋冬转换下准确的识别所有位置。FlyNet + CANN 和 SeqSLAM 的表现相似,并且在冬季和夏季的数据上的表现也比较平衡。基于语义的 LoST-X 的精度则在冬季数据上大幅下降,导致了最低的 AUC。

与 Nordland 不同,Oxford RobotCar 数据集带来了日夜转换的挑战。下图中可以看到所有模型在夜景数据上的 AUC 都有或多或少的下降,SeqSLAM 的 AUC 更是降到几乎为零。在这一数据集上,FlyNet + CANN 取得了最高的 AUC 并且在夜景上的表现也没有过多下降。

图:(上):Precision Recall 曲线 (左)Nordland (右)Oxford RobotCar

(下):AUC (左)Nordland (右)Oxford RobotCar

图源:Chancan, M., Hernandez-Nunez, L., Narendra, A., Barron, A. B., & Milford, M. (2020). A hybrid compact neural architecture for visual place recognition. IEEE Robotics and Automation Letters, 5(2), 993-1000. https://doi.org/10.1109/LRA.2020.2967324

当然,作者使用基于仿生研究的模型结构的一大目的是获得能耗较低但运行速度够快的模型,根据作者对 1000 张图片的平均位置识别时间的统计,FlyNet + CANN 可以达到每秒 16.66 帧的查询速度,比排名第二快模型还要快 1.5 倍以上。这一点为仿生神经网络对比 CNN 提供了强大的竞争力——即便目前的相关研究也很活跃,但 CNN 的能耗和推理速度仍然为在移动端部署模型带来了不小的挑战。而基于昆虫大脑的 FlyNet + CANN 等神经网络,可以将模型参数控制在百万以内,并且没有在模型表现上落后太多。此外,FlyNet + CANN 也继承了昆虫的另一特性——在低分辨率下进行计算,从计算角度直接保证了模型的实时推理的可行性。

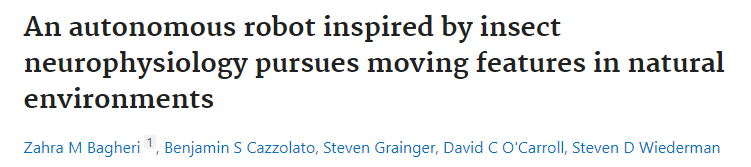

二、追踪 - An autonomous robot inspired by insect neurophysiology pursues moving features in natural environments

计算机视觉和机器人应用往往需要在移动平台上实现强大而有效的目标跟踪算法,但就目前的人工视觉系统的表现而言,在杂乱的背景下检测和跟踪移动物体仍是最具挑战性的任务之一,更遑论对实时系统的部署。而昆虫的视觉系统,则为研究者们提供了一个理想的视觉追踪系统的完美例子。许多飞行昆虫,例如蜻蜓,都能够检测、选择和追捕微小的猎物或同种动物。更令人咋舌的是,昆虫仅有限的视觉分辨率(〜0.5°)、尺寸相对较小的大脑(小于 2 mm 宽)和重量轻和低功率的神经元结构用于处理数据。

本文作者们在之前数年的研究中已经通过细胞内电生理技术来记录昆虫视神经叶内的神经元活动,并确定了一组与目标的检测和追踪相关的神经元,作者将其命名为“小目标运动检测器”(small target motion detectors, STMD)。基于这些生理数据,作者开发了用于局部目标识别的非线性“基础 STMD”(Elementary- STMD, ESTMD)模型(Wiederman 等人,2008),并在 VR 模拟环境中对该追踪系统进行了测试。在本篇论文中,作者主要实现了整套追踪模型在机器人平台上的部署,并在室内和室外环境对该机器人进行了详尽的测试。

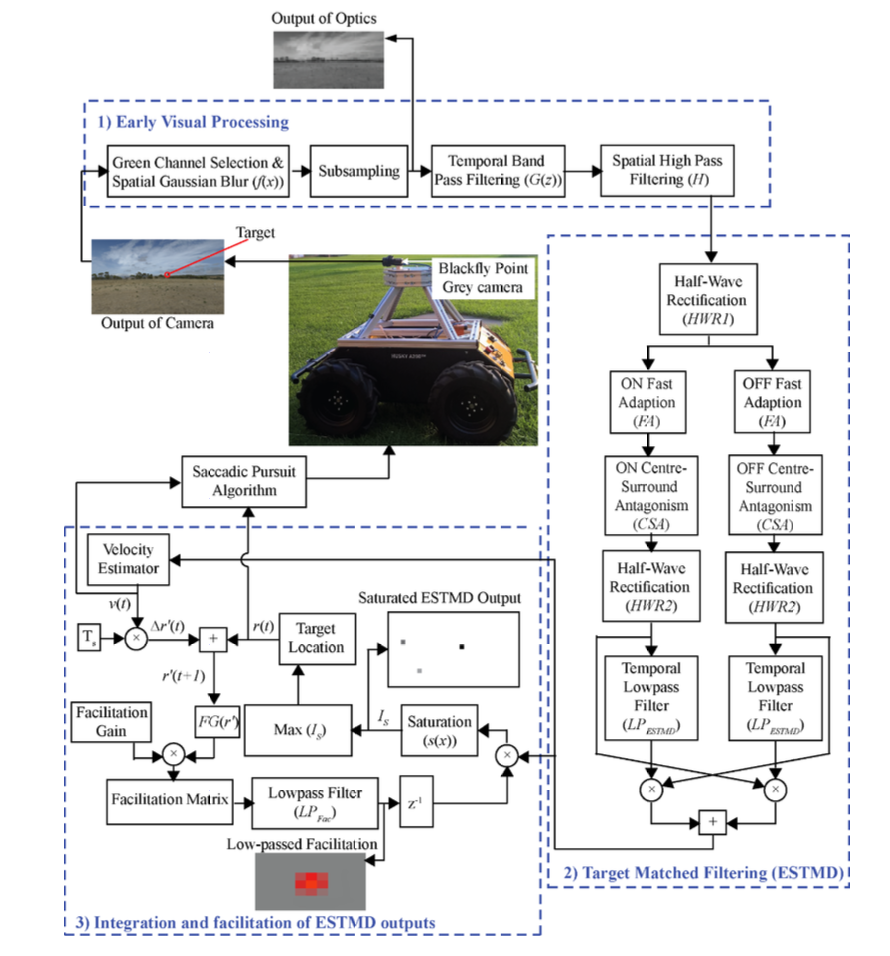

下图中,作者给出了整个系统的工作流程,所有功能在 Husky A200(Clearpath RoboticsTM)平台上实现。机器人身上装有一个 Blackfly 相机,用于获取机器人所处环境的视觉输入。相机输出用作昆虫启发的目标跟踪模型的输入,该模型包括:

1)图像预处理(early visual processing):该模块主要用于模拟飞行昆虫中光学,感光体和大型单极细胞(large monopolar cells , LMC)的响应特性。由于飞行昆虫的光学器件受到小平面透镜内的衍射和其他形式的光学干涉的限制,针对输入的图像,作者首先使用高斯低通滤波器对这种光学模糊进行建模,这与典型的日间活动昆虫的光学采样相似(Stavenga,2003 年)。为在算法的敏锐度和计算效率之间取得平衡,作者还以 1° 的间隔对捕获的图像进行二次采样。另外,作者选择仅处理 RGB 图像的绿色通道来模拟飞行昆虫运动路径的绿色光谱敏感性。接下来,这一模块中还有时间共同滤波和空间高通滤波,以进一步去除多余的信息。

2)目标匹配滤波(Target Matched Filtering,ESTMD 阶段):这一模块主要模拟的是昆虫第二视神经网(2nd optic neuropil)内的 Rectifying transient cells(RTC)。RTC 对光增量(ON 通道)或减量(OFF 通道)具有独立的适应性,在实际实现中,作者通过半波整流(half-wave rectification, HWR1)对 ON 和 OFF 通道的分离进行建模。接下来,生成的 ON 和 OFF 的通道数据需要通过快速适应模块,其中适应状态由切换其时间常数的非线性滤波器确定。当输入增加时,时间常数为“快”(3 毫秒),减少时则为“慢”(70 毫秒)。此外,作者使用了强烈的空间中心包围对抗(spatial centre-surround antagonism),使得每个通道周围都抑制了其最近的邻居。时间适应减少了对背景纹理的响应,而强烈的空间中心包围对抗则传达了对局部边缘特征的选择性。在此输出上,作者添加了第二个半波整流,用于消除负值。到了这一步,在前进方向上,小目标将会首先表现为亮度的升高(或下降),经过短暂的延迟后才出现相应的下降(或升高)。为了充分利用这一特征,作者每个通道的输出与相对通道的延迟版本(下图标记为低通滤波器(LP_ESTMD))相乘,然后对输出求和。这能够赋予最终系统足够的目标灵敏度,而与目标相对于背景的对比极性无关。

3)ESTMD 输出融合(Integration and facilitation of ESTMD output):在这一模块中,处理后的信息将被用于两个方面。一方面,机器人需要根据输入的信息推断追踪目标的位置。输入这一模块的数据首先需要通过双曲正切 “激活” 函数 S(x),以保证所有数据值都在于 0 和 1 之间,其中的最大值将被认为是当前位置估计 r(t)。另一方面,由于目标追踪是一个连续的过程,将此前的信息连续不断的与最新的视觉信息整合起来是必须的。为了模拟昆虫更新信息的融合机制(facilitation mechanism),研究者们可以将当前的位置根据目标速度矢量进行相应的偏移——以作为对目标未来位置的估算——然后加权更新系统地图(Nordström 等人,2011; Dunbier 等人,2011; 2012)。在本文中,通过将当前位置估计(r(t))与由 Hassenstein-Reichardt 基本运动检测器提供的目标速度矢量(v(t))的估计值相乘,并乘以采样时间,可以计算出预测目标位置(r’(t+1))。接下来,作者使用 2D 高斯核 FG(r')来实现轨迹估计和实际观察到的数据之间的融合。文中使用的 2D 高斯核 FG(r')相当于昆虫神经元的感受野之间有 50%的重叠。该输出上将被叠加一个低通滤波器(LP_Fac),处理后的信息将会被用于与下一次的输入信息进行融合,以提供目标在此前的运动轨迹。融合的强度由时间常数 τf 控制,其可以决定 r(t) 周围的位置将被增强多久。

4) 扫视追踪算法(Saccadic Pursuit Algorithm):在飞行过程中,昆虫会绕头移动(saccadic head movements),这是一种 “急速” 转弯——即短而快速的偏航转弯以改变注视方向。为了模拟这一行为,在成功的从视觉线索中识别目标并确定其位置后,追踪算法需要决定相应的前进速度,并保持目标始终在自己的视野中心内。当 ESTMD 输出的位置估计从视场中心移出超过 5° 时,机器人会重新扫视自己的视野并计算需要调整的角度,来模拟昆虫行为中看到的这种绕头移动。使目标保持在视野内的特定角度位置。

图:目标追踪的闭环流程

图:目标追踪的闭环流程

图源:Bagheri, Zahra & Cazzolato, Ben & Grainger, Steven & O'Carroll, David & Wiederman, Steven. (2017). An autonomous robot inspired by insect neurophysiology pursues moving features in natural environments. Journal of Neural Engineering. 14. 046030. 10.1088/1741-2552/aa776c.

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。